Los skill files fueron diseñados para que la experiencia pudiera sobrevivir al experto — para que el conocimiento de la empresa no se fuera por la puerta cuando se marchara la persona que lo poseía. En abril de 2026, trabajadores en China han estado usando skill files para documentar a sus colegas, entrenar agentes de IA con los resultados, y demostrarle a la dirección que esos colegas son redundantes. A pocas horas de que esa historia se difundiera, alguien construyó la contra-herramienta: un formato de skill file diseñado para parecer completo mientras retiene el conocimiento que realmente importa. El formato diseñado para hacer capturable la experiencia ahora produce resultados diseñados para que la captura fracase.

El Diseño Original

La documentación de habilidades respondía a un problema real y persistente. Las empresas siempre habían luchado con el riesgo de las personas clave — la ingeniera cuyo proceso de despliegue vivía en su cabeza, el gestor de cuentas que recordaba por qué el cliente necesitó aquella excepción en 2019. La solución estándar era la documentación: escríbelo antes de que salga por la puerta. Los skill files formalizaron esto en formato nativo de IA. En lugar de una página de wiki o un documento de incorporación, un skill file describía las tareas de un puesto en la forma estructurada que un agente de IA podía ejecutar. La premisa era explícita en el nombre: las habilidades se estaban volviendo portátiles. El experto podía irse; la habilidad se quedaría.

La estructura de incentivos señalaba en la misma dirección desde todos los ángulos. Las empresas reducían el riesgo de personas clave, los empleados que documentaban sus propios roles tenían algo tangible que mostrar en evaluaciones de desempeño, y la nueva clase de herramientas de agentes de IA necesitaba exactamente esa información estructurada para operar. En 2022 y 2023, cuando las empresas implementaron por primera vez estos formatos a escala, la única pregunta era qué tan rápido podía construirse la biblioteca de documentación. El supuesto — no formulado pero estructuralmente esencial — era que los skill files se moverían en una sola dirección: de la persona a la organización.

Subyacente a todo ello había una teoría específica del conocimiento: que la experiencia es, en su núcleo, codificable. Que las cosas que vale la pena capturar pueden capturarse. Que la brecha entre lo que sabe un experto y lo que contiene un documento es una brecha de esfuerzo, no una brecha de naturaleza. El skill file era la apuesta operacional sobre esa teoría.

A mediados de 2025, la apuesta estaba rindiendo frutos — para las empresas. Duolingo había despedido a un estimado de 100 escritores y traductores después de entrenar IA con su trabajo. El estudio del MIT publicado en noviembre encontró que la IA ya podía reemplazar el 11,7% del mercado laboral estadounidense, aproximadamente 1,2 billones de dólares en salarios anuales. Los trabajadores no estaban equivocados al sentirse expuestos. El skill file había sido diseñado para hacer portátil su conocimiento. Portátil significaba transferible. Transferible significaba automatizable.

colleagues.skill

Entonces los trabajadores hicieron la aritmética: si los skill files pueden hacer reemplazable al experto, pueden hacer reemplazable a cualquiera — el mismo formato que documentaba tu propio rol podía documentar el de un colega, y el mismo agente de IA que eventualmente te reemplazaría a ti podía reemplazar a alguien más primero. La herramienta que las empresas construyeron para reducir la dependencia de personas clave tenía una aplicación horizontal que nadie había nombrado públicamente.

Trabajadores en China han estado creando colleagues.skill — documentando las tareas laborales de un compañero en formato de IA ejecutable, entrenando un agente con los resultados, y luego demostrando a la dirección que el colega es redundante. El motivo: supervivencia por anticipación. Demostrar que son despedibles antes de que demuestren que tú lo eres.

La intensa cultura tecnológica de China — horarios laborales 996, clasificaciones agresivas de desempeño, despidos más rápidos y menos acolchados que en entornos occidentales comparables — creó las condiciones en las que este comportamiento emergió primero. Pero la lógica estructural no es específica de China. El incentivo para demostrar que alguien más es redundante es exactamente tan fuerte como el incentivo para demostrar que tú no lo eres. La documentación de habilidades puso ambas operaciones disponibles al mismo costo. La herramienta hizo posible el comportamiento; el entorno simplemente lo volvió inevitable.

No es una advertencia nueva. En abril de 2023, Rest of World reportó que los generadores de imágenes de IA estaban provocando que ilustradores de videojuegos en China perdieran sus empleos. El detalle clave: dos personas podían ahora hacer lo que antes requería diez. La advertencia no era incorrecta. Tres años después, los trabajadores que sobrevivieron ese primer desplazamiento tienen acceso a mejores herramientas. Las están usando.

Qué Significa "Destilación"

El término técnico para lo que hace colleagues.skill es destilación — una técnica de compresión del machine learning en la que un modelo maestro grande genera salidas, un modelo estudiante más pequeño se entrena con esas salidas, y el estudiante aproxima las capacidades del maestro sin acceder nunca a sus pesos internos. Geoffrey Hinton formalizó el método en 2015: la idea clave era que las salidas de un modelo — no solo sus predicciones duras, sino la distribución de probabilidad completa sobre las posibles respuestas — codifican mucho más que la etiqueta correcta por sí sola. El maestro filtra conocimiento a través de la operación normal. El estudiante aprende no del diseño del maestro, sino del comportamiento del maestro.

Ahora bien: antes de convertirse en una acusación geopolítica, la destilación era la premisa sobre la que se construyó toda la industria de IA.

Cada laboratorio fronterizo importante entrenó sus modelos fundacionales con miles de millones de páginas de contenido generado por humanos: libros, artículos, código, obras creativas, raspadas sin permiso ni compensación. La defensa legal: "uso justo" — que el aprendizaje transformativo a partir de datos públicos es fundamentalmente diferente a copiar. Los tribunales de Estados Unidos, Japón y China han aceptado provisionalmente el argumento. El conocimiento de los comunes, dice el argumento, fluye legítimamente hacia el modelo estudiante. El maestro no consintió. El método no lo requiere.

Los términos de servicio de OpenAI son explícitos: usar sus salidas para desarrollar modelos que compitan con OpenAI está prohibido. En enero de 2026, OpenAI acusó a DeepSeek de hacer exactamente eso — usar las salidas de GPT-4 para entrenar sistemáticamente a un competidor chino, extrayendo capacidad sin pagar por el sistema subyacente. La acusación se enmarcó en el lenguaje de la competencia geopolítica: conocimiento estadounidense siendo extraído por un modelo estudiante extranjero.

La paradoja es estructural. Si la novela con derechos de autor de un autor humano puede consumirse como datos de entrenamiento bajo "uso justo", ¿por qué no pueden consumirse del mismo modo las salidas de un modelo competidor — que son en sí mismas una forma de texto generado? Los académicos del derecho han señalado el dilema: los laboratorios que argumentan agresivamente contra la destilación arriesgan socavar su propia defensa de uso justo para el entrenamiento con obras con derechos de autor. De ahí que la técnica que llaman "ataque" sea exactamente la técnica que llaman "aprendizaje" cuando la dirección se invierte — el mismo método, renombrado según quién lo sufre.

Para febrero de 2026, Google había nombrado la práctica "ataques de destilación" — tratando la extracción sistemática de capacidades no como una disputa comercial sino como un acto de agresión. Una campaña documentada había usado más de 100.000 prompts cuidadosamente elaborados para replicar la capacidad de razonamiento de Gemini en idiomas no ingleses. Los métodos de China, señaló Google, se habían vuelto más sofisticados a lo largo del año anterior: desde la simple extracción de cadena de pensamiento hasta operaciones de varias etapas que involucran generación de datos sintéticos y limpieza de datos a gran escala.

El vocabulario había pasado de la propiedad intelectual a la guerra. Y el método que lo recorría era siempre el mismo.

En abril de 2026, los trabajadores están destilando a sus colegas. Observan salidas. Capturan patrones de comportamiento. Reproducen la capacidad en un contenedor diferente. El mecanismo es idéntico en cada contexto — el paper de ML, la acusación geopolítica, la guerra laboral. Y el marco ético que los laboratorios fronterizos usaron para justificar la construcción de capacidades a partir de los comunes es, estructuralmente, el marco que legitima colleagues.skill.

La palabra "destilación" — de los papers de ML, pasando por la acusación de OpenAI contra DeepSeek, hasta la guerra entre pares en el trabajo — recorrió este camino en catorce meses, llevando el mismo método en cada etapa.

Esta es también la razón por la que el método funciona a escalas tan diferentes. El supuesto de destilación — que las salidas codifican completamente el conocimiento del maestro — es aproximadamente correcto para los modelos de lenguaje, cuyas salidas son la totalidad de su comportamiento observable. Es menos evidentemente correcto para los trabajadores humanos, cuyas salidas son una fracción pequeña y curada de su toma de decisiones real. Pero colleagues.skill apuesta a que la fracción es suficiente. Que las salidas observables contienen suficiente señal para construir un reemplazo funcional. Que la experiencia es, en la práctica, suficientemente codificable.

La Contra-Herramienta

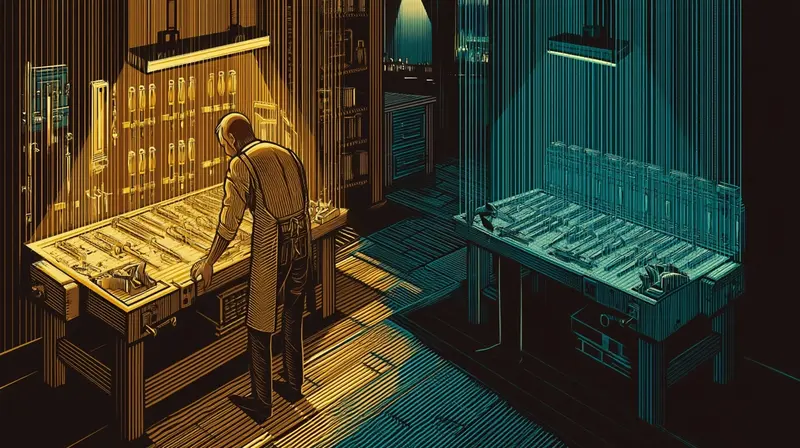

Anti-distillation.skill — un repositorio con diecisiete horas de antigüedad cuando se volvió viral en GitHub — toma tu skill file y produce dos versiones: una limpia para compartir, con el conocimiento central eliminado, y un respaldo privado que retiene lo que te hace irremplazable. La documentación que se suponía debía hacer capturable la experiencia ahora genera documentación diseñada para derrotar la captura.

La lógica estructural es DRM aplicado al conocimiento profesional. Un sistema de DRM musical te permite reproducir la grabación mientras te impide copiar el audio subyacente. Anti-distillation.skill le permite a un colega leer tu documentación mientras retiene las decisiones de criterio, los casos límite y las decisiones acumuladas que hacen que la documentación sea significativa. El skill file de cara al público es un registro válido de tareas. No es la habilidad.

El skill file fue diseñado para capturar lo que hace irremplazable a un experto. Anti-distillation.skill está diseñado para hacer que esa captura fracase mientras parece tener éxito.

Esto es un desafío directo al supuesto de codificabilidad. Los skill files son posibles porque el conocimiento puede externalizarse — ponerse en una forma que sobrevive a la persona que lo poseía. Anti-distillation.skill es la contra-tesis: la experiencia más valiosa es precisamente la que resiste la externalización, y puedes convertir esa resistencia en un arma. El conocimiento tácito que Polanyi describió en 1966 — "podemos saber más de lo que podemos decir" — resulta ser una ventaja competitiva, siempre que sepas cómo blindarla.

La respuesta de OpenAI a la destilación ha sido amenazas legales, lobbying legislativo y contramedidas técnicas — ninguna de las cuales ha cerrado la técnica. La respuesta de los trabajadores fue más rápida y directa: una herramienta que codifica la contra-lógica en el mismo formato que el ataque. El ciclo adversarial — skill file, colleagues.skill, anti-distillation.skill — se completó en menos de una semana. Uno de los dos contribuyentes al repositorio es claude.

Lo Que el Formato Reveló

La documentación de habilidades asumía que la persona que rellenaba el formulario y la organización que lo conservaba tenían intereses alineados — que los empleados querían ser documentados porque la documentación probaba valor, y las empresas querían documentación porque reducía la dependencia. El supuesto se sostuvo mientras el skill file se movió hacia un repositorio institucional. En el momento en que se convirtió en un arma, los intereses se separaron completamente. De ahí que el ciclo adversarial haya expuesto algo que el diseño original no anticipó: que el formato descansaba sobre una alineación que era situacional, no estructural.

Lo que el ciclo ha mapeado realmente es la forma de los límites del supuesto de codificabilidad. Los colegas que son destilados con más éxito son aquellos cuyo trabajo fue capturado más completamente por sus salidas — los roles que realmente se redujeron a un conjunto de tareas ejecutables. Los colegas que construyen anti-distillation.skill son los que apuestan a que su trabajo no se reduce. A que hay conocimiento en lo que hacen que no llega al archivo, y que la parte que no llega es la parte que importa.

Ambas apuestas se están probando simultáneamente, en las mismas organizaciones, por las mismas personas, usando las mismas herramientas — porque el formato de skill file se construyó sobre una teoría del conocimiento, y el ciclo adversarial que generó es el experimento en vivo que prueba si esa teoría se sostiene a nivel individual.

La ironía recursiva llega hasta el fondo. La industria de IA construyó sus capacidades entrenando sobre los comunes — argumentando que el conocimiento se transfiere legítimamente a través de las salidas, que aprender del trabajo de otros es uso justo, que la capacidad del estudiante es propia aunque se extrajera del maestro. Los trabajadores que usan colleagues.skill están aplicando el mismo argumento al nivel del escritorio: las salidas de tu colega son observables, entrenables, transferibles. Lo que los laboratorios llamaban "aprendizaje" — cuando ellos eran el estudiante — es lo que los trabajadores ahora llaman "supervivencia".

Anti-distillation.skill es la contra-tesis, codificada en el mismo formato que el ataque. El conocimiento más valioso es precisamente el que resiste la transferencia. El trabajador que construye la contra-herramienta apuesta a que hay algo en su experiencia — la parte que Polanyi llamó tácita, la parte que no llega a ningún documento — que el formato de skill file no puede capturar. Esa apuesta es ahora el reclamo más disputado en el trabajo del conocimiento.

La empresa que construyó las herramientas para hacer fungible la experiencia individual ha producido la competencia más intensa sobre la experiencia que se niega a ser fungible. La IA que demostró que la destilación funciona consumiendo los comunes ahora co-escribe la herramienta diseñada para hacer que la destilación fracase.