Os skill files foram projetados para que o conhecimento sobrevivesse ao especialista — para que o saber da empresa não fosse embora com a pessoa que o detinha. Em abril de 2026, trabalhadores na China têm usado skill files para documentar seus colegas, treinar agentes de IA com os resultados e demonstrar à gestão que esses colegas são redundantes. Poucas horas depois de essa história se espalhar, alguém construiu a contra-ferramenta: um formato de skill file projetado para parecer completo enquanto retém o conhecimento que realmente importa. O formato criado para tornar a expertise capturável agora produz saídas projetadas para fazer a captura falhar.

O Projeto Original

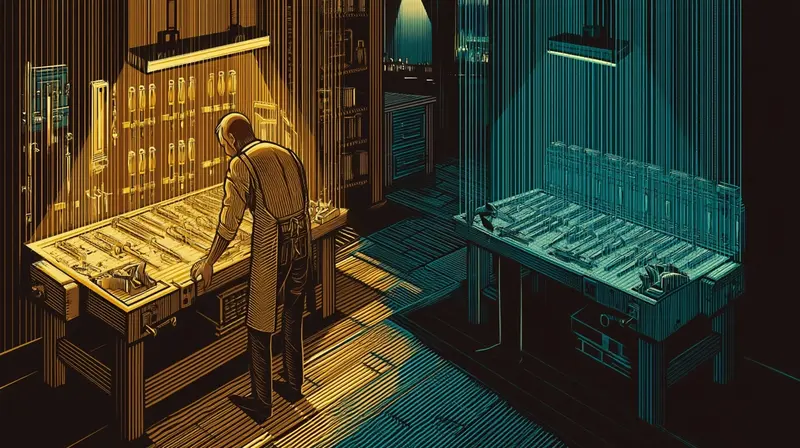

A documentação de habilidades respondia a um problema real e persistente. As empresas sempre lutaram com o risco de pessoas-chave — a engenheira cujo processo de deploy vivia na cabeça dela, o gerente de contas que lembrava por que o cliente precisou daquela exceção em 2019. A solução padrão era documentar: escreva antes que saia pela porta. Os skill files formalizaram isso em formato nativo de IA. Em vez de uma página de wiki ou um documento de integração, um skill file descrevia as tarefas de um cargo na forma estruturada que um agente de IA poderia executar. O nome já dizia tudo: as habilidades viravam portáteis. O especialista podia partir; a habilidade ficava.

Os incentivos se alinhavam de todos os lados. As empresas reduziam o risco de pessoas-chave. Os funcionários que documentavam seus próprios papéis tinham algo concreto para mostrar nas avaliações de desempenho. A nova classe de ferramentas de agentes de IA precisava de input estruturado para funcionar. Em 2022 e 2023, quando as empresas implantaram esses formatos em larga escala, a única pergunta era com que velocidade a biblioteca de documentação poderia ser construída. O pressuposto — não declarado, mas estruturalmente essencial — era que os skill files se moveriam em uma direção: da pessoa para a organização.

O pressuposto não declarado, mas estruturalmente essencial, era uma teoria específica do conhecimento: que a expertise é, em sua essência, codificável. Que as coisas que valem a pena capturar podem ser capturadas. Que o que um especialista sabe e o que um documento captura é a mesma coisa — só falta esforço para fechar o vão. O skill file era a aposta operacional sobre essa teoria.

Em meados de 2025, a aposta estava rendendo frutos — para as empresas. O Duolingo tinha demitido cerca de 100 escritores e tradutores depois de treinar IA com o trabalho deles. O estudo do MIT publicado em novembro concluiu que a IA já podia substituir 11,7% do mercado de trabalho dos EUA, aproximadamente 1,2 trilhão de dólares em salários anuais. Os trabalhadores não estavam errados em se sentir expostos. O skill file havia sido projetado para tornar portátil o conhecimento deles. Portátil significava transferível. Transferível significava automatizável.

colleagues.skill

Então os trabalhadores fizeram as contas.

Se os skill files podem tornar o especialista substituível, podem tornar qualquer um substituível. O mesmo formato que documentava o seu próprio cargo podia documentar o de um colega. O mesmo agente de IA que eventualmente substituiria você poderia substituir outra pessoa primeiro. As empresas criaram a ferramenta para uma direção. Mas ninguém tinha dito isso em voz alta ainda.

Trabalhadores na China têm criado colleagues.skill — documentando as tarefas do trabalho de um colega em formato de IA executável, treinando um agente com os resultados e depois demonstrando à gestão que o colega é redundante. O motivo: sobrevivência por antecipação. Prove que eles são demissíveis antes que eles provem que você é.

A intensa cultura tech da China — jornadas de trabalho 996, rankings agressivos de desempenho, demissões mais rápidas e menos amortecidas do que em ambientes ocidentais comparáveis — criou as condições em que esse comportamento emergiu primeiro. Mas a lógica estrutural não é específica da China. O incentivo para provar que outra pessoa é redundante é exatamente tão forte quanto o incentivo para provar que você não é. A documentação de habilidades colocou ambas as operações disponíveis pelo mesmo custo. A ferramenta tornou o comportamento possível. O ambiente o tornou inevitável.

Em abril de 2023, o Rest of World reportou que geradores de imagens de IA estavam fazendo ilustradores de games na China perderem seus empregos. O detalhe-chave: duas pessoas podiam agora fazer o que antes exigia dez. O aviso não estava errado. Três anos depois, os trabalhadores que sobreviveram àquele primeiro deslocamento têm acesso a ferramentas melhores. Estão usando-as.

O Que "Destilação" Significa

O que o colleagues.skill faz tem nome técnico: destilação.

Em machine learning, destilação é uma técnica de compressão: um modelo professor grande gera saídas; um modelo aluno menor treina com essas saídas; o aluno aproxima as capacidades do professor sem nunca acessar os pesos do professor. Geoffrey Hinton formalizou o método em 2015. O que Hinton percebeu: as saídas do modelo — não só as predições brutas, mas toda a distribuição de probabilidades — carregam muito mais informação do que o rótulo certo sozinho. O professor vaza conhecimento através da operação normal. O aluno aprende não do design do professor, mas do comportamento do professor.

Mas antes de se tornar uma acusação geopolítica, destilação era a premissa sobre a qual toda a indústria de IA foi construída.

Todos os principais laboratórios de fronteira treinaram seus modelos fundacionais com bilhões de páginas de conteúdo gerado por humanos: livros, artigos, código, obras criativas, raspados sem permissão ou compensação. A defesa legal: "uso justo" — que o aprendizado transformativo a partir de dados públicos é fundamentalmente diferente de copiar. Tribunais nos EUA, no Japão e na China aceitaram provisoriamente esse argumento. O conhecimento dos bens comuns, diz o argumento, flui legitimamente para o modelo aluno. O professor não consentiu. O método não precisa disso.

Os termos de serviço da OpenAI são explícitos: usar as saídas deles para desenvolver modelos que concorram com a OpenAI é proibido. Em janeiro de 2026, a OpenAI acusou a DeepSeek de fazer exatamente isso — usar as saídas do GPT-4 para treinar sistematicamente um concorrente chinês, extraindo capacidade sem pagar pelo sistema subjacente. A acusação foi enquadrada na linguagem da competição geopolítica: conhecimento americano sendo extraído por um modelo aluno estrangeiro.

O paradoxo não é acidental — e me parece que a acusação da OpenAI é, ao mesmo tempo, correta e impossível de sustentar. Se o romance com direitos autorais de um autor humano pode ser consumido como dado de treinamento sob "uso justo", por que as saídas de um modelo concorrente — elas mesmas uma forma de texto gerado — não podem ser consumidas da mesma forma? Acadêmicos do direito têm apontado o dilema: laboratórios que argumentam agressivamente contra a destilação arriscam minar sua própria defesa de uso justo para o treinamento com obras protegidas por direitos autorais. A técnica que chamam de "ataque" é a técnica que chamam de "aprendizado" quando a direção se inverte.

Em fevereiro de 2026, o Google havia nomeado a prática de "ataques de destilação" — tratando a extração sistemática de capacidades não como uma disputa comercial, mas como um ato de agressão. Uma campanha documentada usou mais de 100.000 prompts cuidadosamente elaborados para replicar a capacidade de raciocínio do Gemini em idiomas não-ingleses. Os métodos da China, apontou o Google, tinham se tornado mais sofisticados ao longo do ano anterior: da simples extração de cadeia de pensamento para operações de múltiplos estágios envolvendo geração de dados sintéticos e limpeza de dados em larga escala. O vocabulário mudou de propriedade intelectual para guerra.

Em abril de 2026, trabalhadores estão destilando seus colegas. Observam saídas. Capturam padrões de comportamento. Reproduzem a capacidade em um contêiner diferente. O mecanismo é idêntico em todos os contextos — o paper de ML, a acusação geopolítica, a guerra no local de trabalho. E o arcabouço ético que os laboratórios de fronteira usaram para justificar a construção de capacidades a partir dos bens comuns é, estruturalmente, o arcabouço que legitima o colleagues.skill.

A palavra "destilação" — dos papers de ML, passando pela acusação da OpenAI contra a DeepSeek, até a guerra de sobrevivência entre colegas — percorreu esse caminho em quatorze meses, carregando o mesmo método em cada etapa.

É também por isso que o método funciona em escalas tão diferentes. O pressuposto da destilação — que as saídas codificam completamente o conhecimento do professor — é aproximadamente correto para modelos de linguagem, cujas saídas são a totalidade do seu comportamento observável. Com trabalhadores humanos, a aposta é menos óbvia — as saídas deles são uma fração pequena e curada do que realmente decidem. Mas colleagues.skill aposta que a fração é suficiente. Que as saídas observáveis contêm sinal suficiente para construir um substituto funcional. Que a expertise é, na prática, suficientemente codificável.

A Contra-Ferramenta

Anti-distillation.skill aposta no sentido contrário.

O repositório — com dezessete horas de existência quando viralizou no GitHub — pega seu skill file e produz duas versões: uma versão limpa para compartilhar, com o conhecimento central removido, e um backup privado que retém o que faz de você insubstituível. A documentação que deveria tornar a expertise capturável agora gera documentação projetada para derrotar a captura.

A lógica estrutural é DRM aplicado ao conhecimento profissional. Um sistema de DRM musical deixa você tocar a gravação enquanto impede que você copie o áudio subjacente. O Anti-distillation.skill deixa um colega ler sua documentação enquanto retém as decisões de julgamento, os casos extremos e as decisões acumuladas que tornam a documentação significativa. O skill file voltado ao público é um registro válido de tarefas. Não é a habilidade.

O skill file foi projetado para capturar o que torna um especialista insubstituível. O Anti-distillation.skill é projetado para fazer essa captura falhar enquanto parece ter sucesso.

Isso é um desafio direto ao pressuposto de codificabilidade. Os skill files são possíveis porque o conhecimento pode ser externalizado — colocado em uma forma que sobrevive à pessoa que o detinha. Anti-distillation.skill é a contra-tese: a expertise mais valiosa é precisamente a que resiste à externalização, e você pode weaponizar essa resistência. O conhecimento tácito que Polanyi descreveu em 1966 — "podemos saber mais do que podemos dizer" — acaba sendo um fosso competitivo.

A resposta da OpenAI à destilação tem sido ameaças legais, lobby legislativo e contramedidas técnicas — nenhuma das quais fechou a técnica. A resposta dos trabalhadores foi mais rápida e mais direta: uma ferramenta que codifica a contra-lógica no mesmo formato do ataque. O ciclo adversarial — skill file, colleagues.skill, anti-distillation.skill — se completou em menos de uma semana. Um dos dois contribuidores do repositório é claude.

O Que o Formato Revelou

Mas o projeto original não antecipou o que esse ciclo revelaria. A documentação de habilidades pressupunha que a pessoa preenchendo o formulário e a organização que ficava com o formulário tinham interesses alinhados — que os funcionários queriam ser documentados porque a documentação provava valor, e as empresas queriam documentação porque reduzia a dependência. O pressuposto se sustentou enquanto o skill file se movia em direção a um repositório institucional. No momento em que se tornou uma arma, os interesses se separaram completamente.

O que o ciclo realmente mostrou é onde o pressuposto falha. Os colegas mais destilados com sucesso são aqueles cujo trabalho foi mais completamente capturado por suas saídas — os cargos que realmente se reduziam a um conjunto de tarefas executáveis. Os colegas construindo anti-distillation.skill são os que apostam que o trabalho deles não se reduz a isso. Que há conhecimento no que fazem que não entra no arquivo, e que a parte que não entra é a parte que importa.

Ambas as apostas estão sendo testadas simultaneamente, nas mesmas organizações, pelas mesmas pessoas, usando as mesmas ferramentas. O ciclo adversarial que gerou é um experimento vivo testando se essa teoria se sustenta no nível individual. Me parece que o ciclo não é sobre emprego. É sobre o pressuposto filosófico que toda a indústria engoliu sem mastigar.

A técnica que os laboratórios chamavam de "aprendizado" é a técnica que os trabalhadores agora chamam de "sobrevivência".

Anti-distillation.skill é a contra-tese, codificada no mesmo formato do ataque. O conhecimento mais valioso é precisamente o que resiste à transferência. O trabalhador que constrói a contra-ferramenta aposta que há algo em sua expertise — a parte que Polanyi chamou de tácita, a parte que não entra em nenhum documento — que o formato de skill file não pode capturar. Essa aposta é agora a reivindicação mais disputada no trabalho do conhecimento.

A empresa que construiu as ferramentas para tornar fungível a expertise individual produziu a competição mais intensa sobre a expertise que se recusa a ser fungível.

A IA que demonstrou que a destilação funciona ao consumir os bens comuns agora co-escreve a ferramenta projetada para fazer a destilação falhar.